|

原创 世超 差评 之前世超写过一篇 AI 有多耗水的稿子,欧博allbet说是谷歌数据中心去年一年就花掉了一个半西湖的水量。 除了耗水,可能很多人还忽略了一点,那就是 AI 在耗电这块也是一绝。 前两天阿里刚结束的云栖大会上,中国工程院院士、阿里云创始人王坚就打了这么一个比方—— 过去一百年里,全球电动机消耗掉的电量就占到了总发电量的一半,而现在的大模型就相当于新时代的电机。

而这个新时代的 “ 电机 ” ,也是相当耗电。 现在,为了喂饱它这只电老虎,有些公司甚至准备搬出了 “ 核动力 ” 。

其实在业内,关于 AI 和能源之间的话题也是没有断过。 Huggingface 的科学家就专门测试过各个大模型的耗电量和碳排放,世超翻了翻这篇论文,也是直观地感受到了大模型耗电的疯狂。

先是 Huggingface 自家的 BLOOM 大模型,有 1760 亿参数,光是前期训练它,就得花掉 43.3 万度电,我换算了下,相当于国内 117 个家庭一年用掉的电量。 和它参数量相当的 GPT-3 ,耗电量就更不受控制,同样是前期训练,就要用掉 128.7 万度电,足足是前者的三倍。 甚至有人做过这样一个类比, OpenAI 每训练一次,就相当于 3000 辆特斯拉同时跑 32 公里。。。

这还只是 AI 前期训练用的电,在后期使用过程中累积的耗电量才是大头。 一般来说,训练就是不断调整参数、重复训练,最后得到一个使用体验最好的模型,整个过程是有限度的。 后期的推理过程就不一样了,比如我们用 ChatGPT ,每问一次问题都相当于是一次推理请求。 现在 ChatGPT 的月活用户早已经破亿,它每天推理的频次的飙升可想而知。 更具体一点,欧博百家乐拿自动驾驶来说,前期训练花费的能耗成本就只有两三成,剩下的七八成都是后期的推理消耗的。

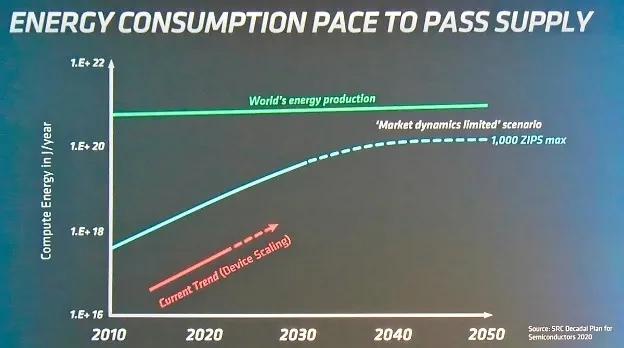

《晚点 LatePost 》之前也拿 ChatGPT 做了这么一个测算,按日均最高访问量 2.7 亿次来计算,假设每个人每次访问会问五个问题,一整个月下来光是推理消耗的电量就是 1872 万度。 总的来讲, AI 这几年来消耗的电力正在以指数级别增长,然而现在全球发电已经差不多已经趋于平缓。 照这个态势发展下去,估计再过几十年,光是 AI 的耗电量,就足以导致全球用电荒了。。。 来自 AMD ,红色表示 AI 能耗,绿色表示现有能源

而之所以这么耗电,一方面和近几年来 AI 圈子内部搞起的军备竞赛不无关系。 国外在 OpenAI 之后,谷歌、 Meta 自家大模型的研发迭代也没停过。 国内卷得就更厉害,百度的文心一言、阿里的通义千问、腾讯的混元等等等等,参数一个赛一个高,这还只是大厂们的赛道,一些大模型初创企业更是海了去了。

另一方面, AI 用掉这么多电,和它背后数据中心不无关系。 在数据中心,用电最多的地方就是 AI 服务器,因为要有大规模的计算,普通的服务器根本就不够用,还得用专属的 AI 服务器。 然鹅 AI 服务器,光是功率就比普通服务器高出了六七倍,普通服务器一般只需要两个 800W~1200W 的电源, AI 服务器,则要 4 颗 1800W 的高功率电源。 emmm 这不耗电都说不过去。。。 AI 的耗电,当然卷大模型的厂商比我们清楚得多,毕竟在他们那里可是真金白银的电费哗哗往外流。。。 所以在解决 AI 能耗的问题上,业内也是使出了浑身解数。 第一个办法是想办法提高 AI 芯片性能,性能上去了,耗电自然而然也就下去了。

另外一个办法就简单粗暴了,既然耗电多导致电费高,那找个更便宜的能源不就行了。 就比如国内目前就在搞 “ 东数西算 ” 的工程,在西部清洁能源丰富的地区建立数据中心,用来处理东部的数据。 并且东部地区数据中心密集,工商业的平均电价大概在 0.676 元 / 度,而西部地区平均电价在 0.541 元 / 度,钱不就这么省下来了么。

有些公司则又看准了核能赛道。 像 OpenAI 和微软都先后投资了核能发电,不过不是传统的核裂变发电方式,而是还在实验室阶段的核聚变。 早在 2015 年, OpenAI CEO 奥特曼就对核聚变发电感兴趣了,向一家核聚变初创企业 Helion 投资了 950 万美金, 2021 年,又给它豪掷了 3.75 亿美元。

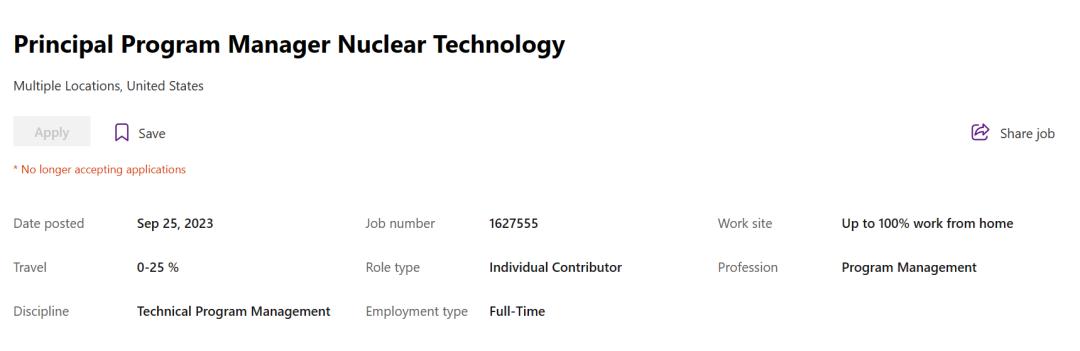

紧接着在今年 5 月份,在核聚变发电站还没着落的时候,微软就和 Helion 签订了购电协议,说要在 2030 年前实现负碳目标。 世超倒真有点好奇,这个 Helion 到底有什么魔力,在八字还没一撇的时候,让 OpenAI 和微软先后都在它身上下这么大的注。 不过这事吧,从它给微软的的承诺中就能窥探出一二。Helion 在那份购电协议中表示, 2028 年前上线的核聚变装置,在一年内会把发电功率提升到 50 兆瓦以上。 什么概念?相当于撑起 40000 户家庭的供电。 更重要的是,买核聚变发出来的电,还贼拉便宜,折合成人民币相当于 7 分钱一度电,这诱惑谁挡得住啊。 微软也没把所有鸡蛋放在一个篮子里,在下注核聚变发电的同时,他还看好了近几年发展起来的小型核反应堆( SMR )。 不久前,微软发了个招聘通知,说要找个 “ 核技术首席项目经理 ” ,来管SMR 这块的工作。

和传统核电的大型反应堆比,理论上 SMR 这玩意儿体积更小,甚至可以在工厂里批量生产。 发电功率也是传统反应堆的三倍,并且 SMR 也不用担心损坏时释放放射性元素,因为它能在第一时间自动关闭系统。 同时 SMR 也更省钱,平均每 1000 度电下来就能省将近 100 美元。。。 当然,这些东西目前还是八字没那一撇, AI 耗电猛的现状,短时间内也很难会得到改变。 各种核聚变项目,世超也不好说它们到底能不能成。 但 AI 的发展,说不定会给核能来一记大助攻。 如果这个世界是一局电子游戏的话,说不定可控核聚变的科技树,正好就在 AI 之后呢。 撰文:松鼠 编辑:江江 & 面线 封面:萱萱 图片、资料来源: David Patterson,Carbon Emissions and Large Neural Network Training WSJ,Artificial Intelligence Can Make Companies Greener, but It Also Guzzles Energy 虎嗅,训练一次ChatGPT,“折寿”3000辆特斯拉 IT之家,AI 能耗成本太高,微软考虑用核电来为数据中心供能 晚点 LatePost,ChatGPT 每月用的电已经够一个小城镇生活 华尔街见闻:AI耗电的“终极解决方案”:小型核反应堆 sciencealert,AI Keeps Using More And More Energy. Where Will It End? 神译局,AI的B面:能耗爆发式增长,电力撑得起AI的算力吗?

原标题:《AI训练一次,把我家这辈子的电都用完了。。。》 (责任编辑:) |